GPT模型区别详解:GPT-3.5、GPT-4、GPT-4o到GPT-5全对比

在人工智能快速发展的浪潮中,OpenAI 的 GPT 系列模型堪称引领者。从 GPT-3.5 到 GPT-5,每一次更新都代表着自然语言处理(NLP)技术的一次重大飞跃。虽然它们在命名上看似只是数字变化,但实际上在架构、性能、速度、成本、输入输出能力、多模态支持等方面都有质的差别。本文将从技术、使用体验、适用场景等多个角度,详细剖析 GPT-3.5、GPT-3.5 Turbo、GPT-4、GPT-4o 和 GPT-5 之间的核心区别。

一、模型发展概览

| 模型版本 | 发布时间 | 模型类型 | 多模态支持 | 性能与速度 | 定位用途 |

|---|---|---|---|---|---|

| GPT-3.5 | 2022年11月 | 纯文本大模型 | ❌ | 较快但理解力一般 | 基础对话与代码生成 |

| GPT-3.5 Turbo | 2023年3月 | 轻量优化版 | ❌ | 更快更便宜 | 高性价比任务与API调用 |

| GPT-4 | 2023年5月 | 高精度模型 | ✅(图像理解) | 理解深度强,速度较慢 | 专业内容生成与推理 |

| GPT-4o | 2024年5月 | 全模态(Omni) | ✅(图像、语音、视频) | 快速且稳定 | 多模态交互与实时应用 |

| GPT-5 | 2025年 | 超级多模态+智能体 | ✅(全模态+推理) | 极快且智能 | 具备自学习和逻辑决策能力 |

从表格可以看出,GPT 系列经历了从“语言模型”到“通用智能体”的演化路径。接下来我们分模块分析每个模型的核心区别。

二、架构与训练数据的演进

1. GPT-3.5:语言理解的里程碑

GPT-3.5 是 GPT-3 的优化版本,采用了更高效的微调技术和更大的训练语料。它在文本生成、代码补全、问答准确率等方面较 GPT-3 提升显著。

- 参数规模:约1750亿参数

- 训练数据:覆盖2021年底之前的网络语料、代码仓库、书籍等

- 优点:响应速度快,语法准确率高

- 缺点:推理深度不足,易产生“幻觉”答案

示例:

# GPT-3.5 常见表现

问:请解释什么是量子纠缠?

答:量子纠缠是一种粒子之间的量子状态相关性,当一个粒子状态变化时,另一个粒子状态会即时变化。

GPT-3.5 能正确描述概念,但缺乏深入推理,比如无法进一步说明“纠缠”与“非局域性”的关系。

2. GPT-3.5 Turbo:高性价比版本

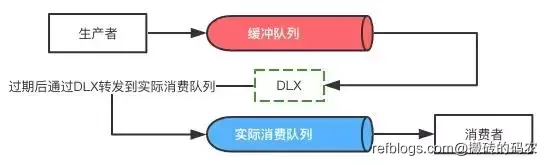

GPT-3.5 Turbo 实际上并非“新架构”,而是 OpenAI 对 GPT-3.5 的压缩与优化版本。它使用更高效的推理机制与缓存策略,能以更低成本提供相似甚至更快的性能。

- 价格优势:API 成本低于 GPT-3.5 一半

- 响应速度:提升约30%

- 适用场景:聊天机器人、客服系统、大规模API服务

总结一句:GPT-3.5 Turbo 是性能与成本的平衡点。

三、GPT-4 的突破:理解与创造的双重飞跃

GPT-4 是 OpenAI 的一个质变节点。其核心突破在于:

- 引入多模态理解能力(文本+图像);

- 语言推理与逻辑链改进;

- 更高的可控性与稳定性。

技术特点:

- 支持图像输入,可进行视觉问答(VQA)

- 上下文理解能力提升显著(可处理3万token上下文)

- 输出风格更自然,幻觉率下降约40%

示例:

# GPT-4 可进行图像分析

上传:一张图表

提问:请描述这张图表的主要趋势。

答:图表显示2020年至2023年间电动汽车销量逐年增长,其中2022年增长率最高。

GPT-4 能够结合视觉内容生成文本,并具备跨模态推理能力,极大扩展了AI在科研、教育、设计领域的应用边界。

四、GPT-4o:全模态的新时代

GPT-4o 中的“o”代表 Omni(全能)。这是 OpenAI 在 2024 年提出的“通用多模态模型”,其核心理念是让 AI 能够实时理解和输出“任何类型”的数据:文字、图像、语音、视频。

主要特性:

- 全模态输入输出:支持实时语音对话、图像理解、视频分析。

- 响应延迟极低:语音响应仅 232 毫秒,接近人类对话反应速度。

- 内置情感识别与上下文记忆能力。

- 跨语言推理能力提升:可直接在多语言环境中进行语义等价转换。

实际应用:

- 智能客服系统:支持语音+文字+情绪识别。

- 教育与医疗:通过实时视频识别与语音交互进行教学/诊断辅助。

GPT-4o 标志着 AI 从“生成文字”进入“理解世界”的阶段。

五、GPT-5:迈向通用人工智能(AGI)的关键一步

GPT-5 于 2025 年正式推出,是 OpenAI 向 AGI(Artificial General Intelligence)迈出的重要一步。它不仅是一个模型,更像一个 智能体(Agent)。

技术特征:

- 自学习与持续记忆:GPT-5 可在对话中主动总结、优化自己的输出风格。

- 全模态融合推理:在图像、语音、文本、视频等多数据类型中进行跨模态逻辑推断。

- 逻辑推理能力大幅提升:在复杂决策问题中表现接近人类专家。

- 支持任务自动化(Autonomous Agents):能自主规划与执行多步任务。

示例:

# GPT-5 的典型场景:任务规划

用户:帮我写一个博客并自动发布到我的网站。

GPT-5:

1. 已分析主题方向。

2. 正在生成博客草稿。

3. 已格式化为Markdown并通过API上传至WordPress。

GPT-5 不仅能生成文本,还能执行任务。它具备“操作”与“推理”的结合能力,是朝“具备意图理解的智能体”方向迈进的版本。

六、性能对比总结

| 指标 | GPT-3.5 | GPT-3.5 Turbo | GPT-4 | GPT-4o | GPT-5 |

|---|---|---|---|---|---|

| 文本理解 | ★★★ | ★★★ | ★★★★ | ★★★★★ | ★★★★★ |

| 推理能力 | ★★☆ | ★★★ | ★★★★ | ★★★★★ | ★★★★★+ |

| 多模态支持 | 无 | 无 | 有(图像) | 全模态 | 全模态+自推理 |

| 成本 | 低 | 极低 | 中 | 低 | 中偏高 |

| 响应速度 | 快 | 更快 | 稍慢 | 非常快 | 快且智能 |

| 任务执行 | 无 | 无 | 有限 | 中等 | 自主执行 |

七、选型建议

| 使用场景 | 推荐模型 | 理由 |

|---|---|---|

| 聊天机器人 | GPT-3.5 Turbo | 成本低,速度快 |

| 内容创作/博客 | GPT-4 | 输出稳定,语言优美 |

| 多模态教学/医疗 | GPT-4o | 全模态交互能力强 |

| 智能体开发、自动任务 | GPT-5 | 支持自学习与任务规划 |

八、结语:从语言到智能体的跃迁

从 GPT-3.5 到 GPT-5,OpenAI 完成了从“语言理解”到“世界理解”的跃迁。GPT 已经不只是一个聊天模型,而是一个可以协助决策、执行任务、理解情感的 通用智能系统。未来,随着自学习、自推理技术的成熟,GPT-5 及其后续版本将逐步接近人类的思维模式,成为真正的“智能伙伴”。